În bună măsură relevanța întrebărilor privind impactul evoluției tehnologice, în special al Inteligenței Artificiale (AI, pentru a folosi acronimul consacrat în limba engleză), este dată de urgența asociată acestui fenomen. Preocupările pe tema AI au caracter urgent?

Răspunsul la această întrebare mi-a fost sugerat în bună măsură de articolul lui Yochai Benkler, Don’t let industry write the rules for AI, publicat în revista Nature la începutul acestei luni. Nu voi insista însă asupra pericolelor pe care autorul le evidențiază ca derivând din prea multa putere pe care sectorul industrial o are în domeniul AI, ele putând fi găsite cu ușurință în conținutul articolului. Cele patru demersuri actuale indicate de Yochai Benkler pe tema stabilirii unor reguli pentru AI, respectiv cele ale National Science Foundation, Comisiei Europene, Google și Facebook, sugerează că există o urgență.

Propunerea mea este să fim atenți la încercările normative având ca temă AI pentru a descoperi pericolele care ne amenință (și niscaiva indicii privind probabilitatea lor). În acest sens, recomand aplicare metodei fenomenologice combinată cu lectura inversă asupra textelor cu caracter normativ. În discuție este o formă specială de reducție fenomenologica a textului juridic în cadrul căreia lectura inversă, având atenția orientată către pericolele pe care norma juridică încearcă sa le evite, ne evidențiază realitățile de care se teme societatea care elaborează acel text. Metoda are la bază o presupoziție simplă: orice interdicție/sancțiune din sistemul juridic al unei societăți evidențiază fenomenele care există în acea societate, împreună cu amploarea lor.

Vă propun să aplicați această metodă la singurul text cu intenție normativă pe care-l avem până acum din cele patru demersuri amintite, respectiv cel al CE, și la un set de reguli mai vechi, devenite cumva tradiționale în lumea celor preocupați de unul din chipurile AI, robotica, propus de Isaac Asimov:

I. Cele 3(+1) legi ale robotici propuse de Isaac Asimov:

- Un robot nu are voie să pricinuiască vreun rău unei ființe umane, sau, prin neintervenție, să permită ca unei ființe omenești să i se facă un rău.

- Un robot trebuie să se supună ordinelor date de către o ființă umană, atât timp cât ele nu intră în contradicție cu Legea 1.

- Un robot trebuie să-și protejeze propria existență, atât timp cât acest lucru nu intră în contradicție cu Legea 1 sau Legea 2.

(4. Un robot nu are voie să pricinuiască vreun rău umanității sau să permită prin neintervenție ca umanitatea să fie pusă în pericol.)

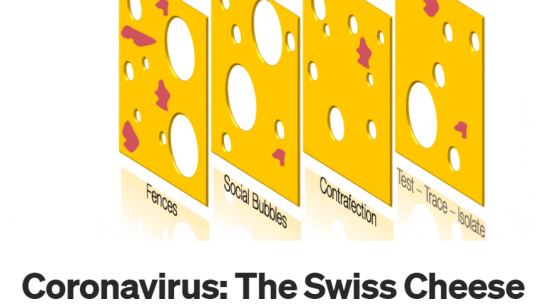

II. Ethics Guidelines for Trustworthy AI (Linii directoare pentru o inteligență artificială demnă de încredere ), publicate de Comisia Europeană (CE) în urmă cu exact o lună. Experții Comisiei consideră că, pentru a fi demnă de încredere, AI:

- Ar trebui să:

- Respecte prevederile legale (o lectură posibilă: Există un pericol semnificativ ca AI să nu respecte prevederile legale.)

- Respecte principiile etice (…)

- Fie robustă din punct de vedere tehnic și să ia în considerare respectarea mediului

- Ar trebui să îndeplinească 7 condiții esențiale:

- Să respecte decizia și supravegherea umană

- Să fie robustă tehnic și sigură pentru oameni

- Să respecte regulile de protecție și guvernanță a datelor personale

- Tehnologiile care stau la baza AI și utilizarea acestor tehnologii să fie transparente

- Să respecte regulile de corectitudine, diversitate și nediscriminare

- Să fie benefice oamenilor, inclusiv generațiilor viitoare

- Să aibă responsabilitate

Pe lângă faptul că CE încearcă să ofere o definiție de cca. 6 pagini a AI, ea mai propune și o European AI Alliance.

Încerc să sugerez că riscăm o formă de defazare față de preocupările prezentului: dacă nu acordăm suficientă atenție marilor probleme contemporane tindem să rămânem captivi mental în încercările de-a găsi soluții pentru a scăpa de saltul în epoca feudală la care ne forțează Dragnea &. Dincolo de încercările politicienilor de-a impune diferite forme de absolutism (o modă ce traversează mai multe state), utilizând forme ale „Marelui Salt Înapoi” (care se vede ca fiind „Înainte” dacă ne așezăm – asemenea lor – cu spatele la viitor), ar trebui să alocăm niscaiva resurse mentale pentru meditația pe teme ce aparțin unui viitor posibil, către care se pare că ne îndreptăm cu o viteză tot mai mare. Pentru a înțelege mai ușor pericolele, să ne imaginăm forme de AI care au „chipurile” (adică efecte sociale similare cu cele ale) lui Dragnea, Nicolicea, Ghiță, Mazăre, Blejnar, Udrea etc. Izolarea în care încearcă sa ne împingă acești vătafi ce se visează Domnitori ar putea fi anulată de globalizarea pe care o va aduce evoluția tehnologică (nu însă și pagubele generate de înapoierea socială in care ne împing astfel de politici).

NOTĂ: Acest text face parte din demersul prealabil conferinței Smart Cities Need Upgraded Humans / Orașele inteligente au nevoie de oameni perfecționați, la care vă invit să participați!